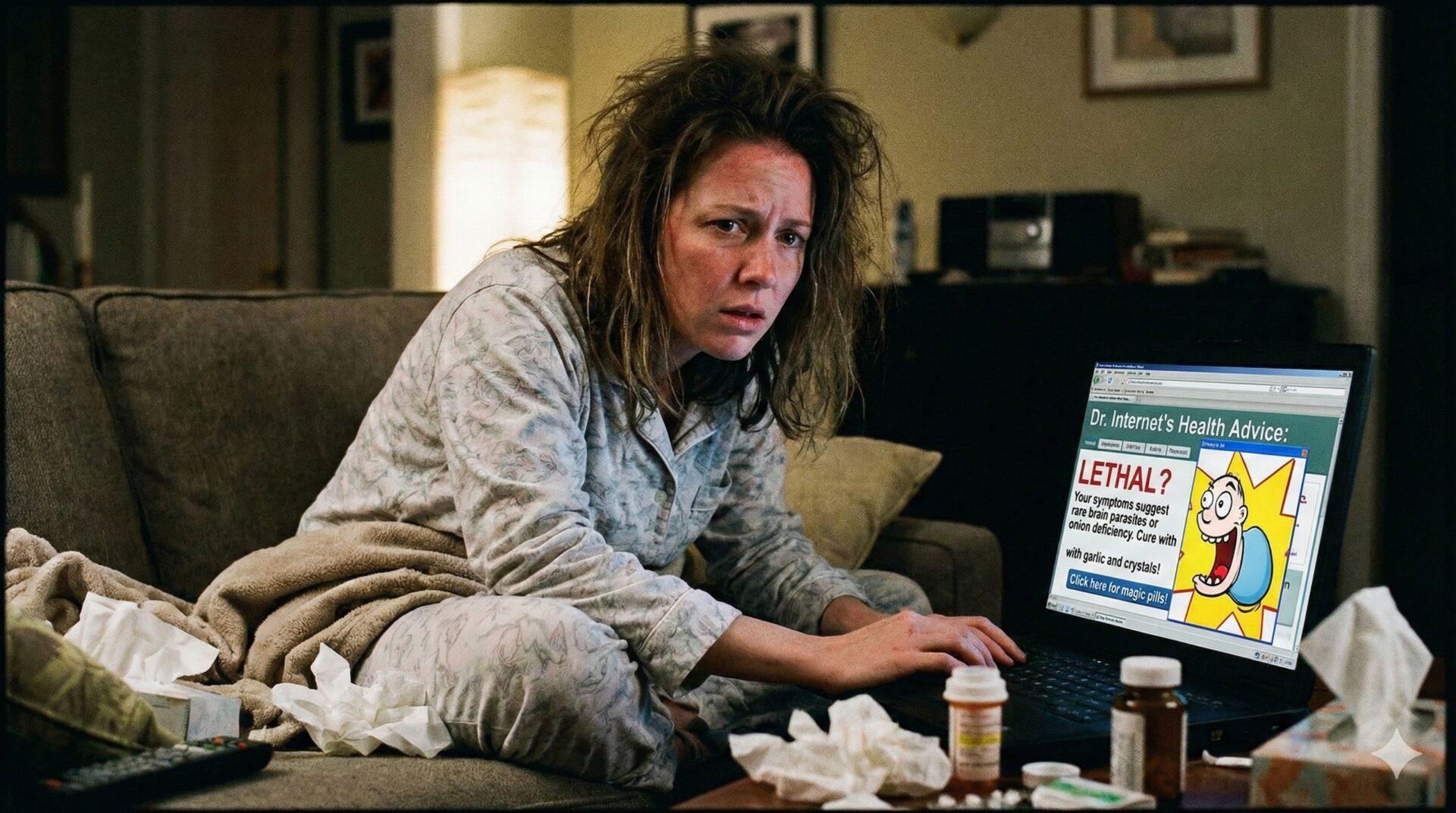

Vi använder alltmer chatbottar och AI-sammanfattningar för leta information. I många fall är det ett snabbt sätt att skaffa sig översiktlig information som man sedan kan gräva vidare i. Men många förlitar sig på chatbottarna för att ställa frågor om sin hälsa och litar allt för mycket på att AI-sammanfattningen är korrekt. Något som i extrema fall kan få tragiska följder.

När man googlar får man numera ofta en AI-sammanfattning överst. Men om den är korrekt eller inte beror på var den hämtar sin information. Enligt Google är svaren på medicinska frågor ”pålitliga” och citerar bra källor som smittskyddsmyndigheter och sjukhus. Men en tysk studie visar att sammanfattningen visar att den förlitar sig på Youtube-videor 2-3x oftare än medicinska källor.

Google menar att det finns gott om bra kanaler för medicinsk information på Youtube och att det därför är en bra källa. Forskarna påpekar dock att vem som helst, oavsett om man är läkare, influerare, hälsocoach eller kvackare, kan ladda upp videor. I studien studerades över 50 000 hälsorelaterade sökningar. I 82 procent av dem fick man en sammanfattning och då undersöktes vilka källor den använt.

Den vanligaste källan var Youtube med 20 621 citat av totalt 465 823. Enligt forskarna tyder det på att synlighet och popularitet väger tyngre än den medicinska tillförlitligheten.

Undersökningar i Tyskland visar att

- 55% av chatbot-användarna använder AI för hälsoråd

- 50% säger att AI hjälper dem att förstå symptom bättre än en Google-sökning.

- 30% säger att ett AI-svar känns som en andra medicinsk bedömning.

- 16% säger att de har ignorerat sin doktor därför att AI inte hållit med.

I ett fall som beskrivs som ”farligt” och ”alarmerande” gav sammanfattningen felaktig information om levertester som kunde ha lett till att folk med allvarliga leversjukdomar felaktigt hade kunnat tro att de var friska. Google har sedan dess tagit bort sammanfattningar för vissa, men långt ifrån alla, medicinska sökord.

ChatGPT är inte mycket bättre då det visat sig att den anser att Elon Musks Grokipedia är en bra källa till information. Detta trots att den upprepade gånger visat sig vara full av nonsens och rena lögner.

Här är vad du bör göra

Slutsatsen är att man absolut inte ska förlita sig på AI-sammanfattningar eller chatbottar för medicinsk information och definitivt inte tro att man kan få en korrekt diagnos. Gå till en läkare istället!

Däremot går det alldeles utmärkt att använda AI för att sammanfatta information, få hjälp att formulera texter och skapa bilder. Som vår inledande bild överst. Sammanfattningarna ska ses som just det, men man måste klicka sig vidare till källorna för att få den riktiga informationen.

Källa: The Guardian och den tyska studien